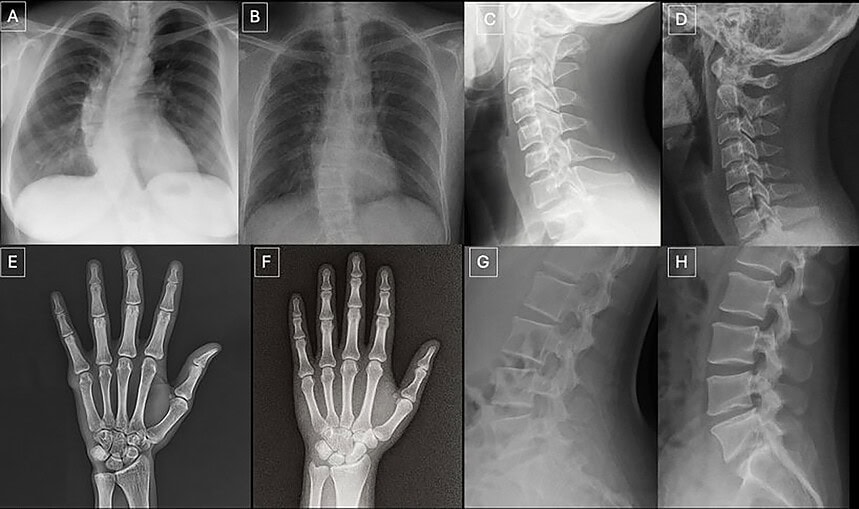

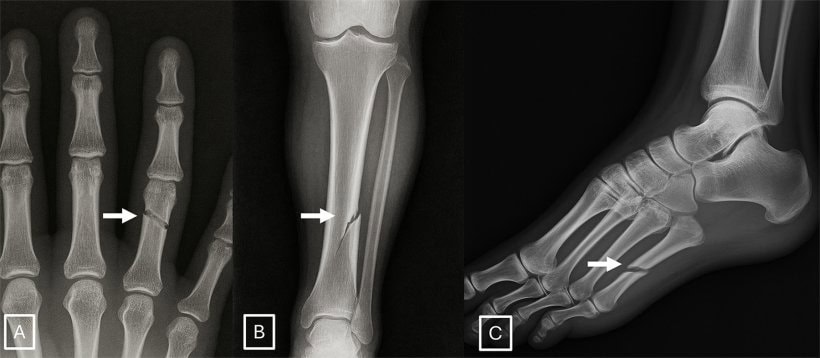

Yapay zekâ tartışması yeni bir eşiğe daha geldi. Bu kez mesele sadece fotoğraf, video ya da ses üretmesi değil. Son araştırmalara göre yapay zekâ, gerçeğine çok benzeyen sahte röntgen görüntüleri de üretebiliyor. Dahası, bu görüntüler bazı radyologları ve bazı yapay zekâ sistemlerini bile yanıltabiliyor.

Araştırmada 12 farklı merkezden, 6 ülkeden 17 radyolog yer aldı. Toplam 264 röntgen görüntüsü incelendi. Bu görüntülerin yarısı gerçekti, yarısı ise yapay zekâ ile üretilmişti. Radyologlar ilk aşamada, görüntülerin sahte olabileceği özellikle söylenmeden değerlendirme yaptı. Sonuç çarpıcıydı: Sahte görüntüleri doğru ayırt etme oranı yalnızca yüzde 41’de kaldı. Katılımcılara görüntüler arasında yapay zekâ ile üretilmiş olanlar da bulunduğu söylendiğinde bu oran yüzde 75’e çıktı. Yani uzmanlar uyarıldığında daha başarılı oldu ama ilk bakışta sahte görüntüler ciddi biçimde kafa karıştırdı.

Üstelik sorun sadece insanlar değil. Reuters’ın aktardığına göre GPT-4o, GPT-5, Gemini 2.5 Pro ve Llama 4 Maverick gibi gelişmiş sistemler de sahte röntgenleri ayırt etmede değişen oranlarda zorlandı. Bazı modeller daha iyi sonuç verdi, bazıları daha düşük doğrulukta kaldı. Bu da yapay zekânın, başka yapay zekâları bile yanıltabilecek kadar ikna edici tıbbi görüntüler üretebildiğini gösteriyor.

Buradaki asıl tehlike, kötüye kullanılma ihtimali. Araştırmacılar bu tür görüntülerin dolandırıcılık, yanlış teşhis, sahte hasta kaydı, sigorta suistimali ya da sağlık verisinin manipülasyonu gibi alanlarda kullanılabileceği uyarısında bulunuyor. Radyoloji gibi güvenin temel olduğu bir alanda, görüntünün gerçek olup olmadığından emin olamamak çok daha büyük bir sorunun kapısını açıyor. Bu yüzden çalışma aynı zamanda, sağlık sisteminde güvenlik ve doğrulama sorunu olarak görünüyor.

Araştırmanın bir başka dikkat çekici bulgusu da şu: Uzmanlık süresi her zaman koruma sağlamıyor. ScienceDaily’nin aktardığına göre radyologların yıllar içindeki deneyimi ile sahte görüntüleri yakalama başarısı arasında güçlü bir ilişki bulunmadı. Buna karşılık kas-iskelet alanında çalışan bazı radyologların daha iyi performans gösterdiği belirtildi. Yani tecrübeli bir doktorun, sahte röntgeni hemen anlayabileceği gibi bir bilgi çok da kanıtlanabilir bir gerçek değil.

Peki çözüm ne olabilir? Uzmanlar, tıbbi görüntülere görünmez filigranlar eklenmesi, cihazdan çıktığı anda kriptografik imza oluşturulması ve görüntülerin kaynağının teknik olarak doğrulanması gibi yöntemler öneriyor. Bir başka deyişle, yapay zekâ güçlendikçe sadece teşhis araçlarını değil, doğrulama mekanizmalarını da güçlendirmek gerekecek.

Kısacası yapay zekâ artık sadece sanatçıyı, yazarı ya da tasarımcıyı tedirgin etmiyor. Şimdi sağlık sisteminin en hassas alanlarından birine de dokunuyor. Röntgen gibi en temel görüntüleme araçlarında bile gerçeğe çok yakın sahteler üretilebiliyorsa, önümüzdeki dönemde asıl soru şu olacak: Gördüğümüz şey gerçekten bir hastaya mı ait, yoksa yapay zeka tarafından çok iyi üretilmiş sahte bir görüntü mü?

Bu haber Haber Kocaeli özel içeriğidir. 5846 sayılı Fikir ve Sanat Eserleri Kanunu kapsamında korunmaktadır. Kaynak gösterilerek dahi olsa haberin tamamı veya bir kısmı, yazılı izin alınmaksızın kullanılamaz, başka mecralarda yayınlanamaz.